Šta je dipfejk i kako se snimci koji kruže internetom poigravaju sa razumom korisnika

Korisnici društvenih mreža su se ovih dana susreli sa čak nekoliko zanimljivih video snimaka, a možda nam nijedan od njih ne bi ni zapao za oko da u njima Ilon Mask ne spominje Kosovo, rakiju, čuvenu Golf "dvojku" i komšijsku nam Bosnu i Hercegovinu. U čemu je caka i kako to da je biznismen tog "kalibra", koji stoji iza nekoliko najvećih svetskih kompanija, odjednom obratio pažnju na balkanske zemlje i čak najavio da se sprema za posetu?

Elon šljokara 😂😂🥃🥃🥃 pic.twitter.com/O91zGMAwp7

— Inanna 👑 (@inanna1814) December 3, 2023

Šta je dipfejk tehnologija i kako se poigrava sa našim mozgom

Iza ovakvih video snimaka, čiji su glavni akteri najčešće javne ličnosti, stoji niko drugi do veštačka inteligencija, odnosno posebno specijalizovani softveri koji generišu sadržaj na osnovu korisničkih upita. Kao ni kod drugih programskih rešenja u čijoj je osnovi AI, ni ovde granice ne postoje, a sudeći po generisanim snimcima, ni etika, a ni svest o potencijalnim posledicama.

Kako funkcioniše dipfejk tehnologija? Za početak, korisnik daje što je više moguće ulaznih podataka: format snimka koji želi da dobije, pregršt fotografija i snimaka lika koji želi da bude na generisanom videu, kao i tekst koji želi da "osoba" izgovara. AI softver potom obrađuje sve te ulazne podatke, kopira facijalne ekspresije i mimiku, prilagođava građu i crte lica i generiše video snimak koji je toliko realističan da samo vešto oko može da prepozna da je u pitanju varka.

Nažalost, veliki broj korisnika, naročito onih starijih, na njih naivno "naseda". No, to i nije toliko strašno ukoliko se radi o sadržaju koji je zabavnog karaktera, ali može imati ozbiljne posledice ako se upletu političke, ili teme koje se tiču zdravlja ili finansija. Tako, primera radi, na snimku niže, bivši američki predsednik Donald Tramp najavljuje da će se, ukoliko ponovo dođe na vlast, osvetiti onima koji su mu se u zatvoru zamerili.

@harryamax Donald Trump want's revenge 🔥 🔥 Don't forget to follow me, for more funny deep fakes🔥 #funnyvideos#AI#donaldtrump#politics♬ Originalton - Harryama ♦️

Vladimir Putin, Tom Kruz i druge "žrtve" dipfejk tehnologije

"Žrtve" dipfejk tehnologije, smo svi mi - i javne ličnosti čiji se identitet zloupotrebljava, i mi, gledaoci, kojima se plasira sadržaj koji nema ni jednu dodirnu tačku sa realnošću. Jedan od najboljih primera dipfejk tehnologije je nalog na društvenoj mreži TikTok koji "pripada" holivudskoj zvezdi Tomu Kruzu: sadržaj je toliko realističan, da jedva da ostavlja prostor da pomislite da tu nešto "ne štima".

@deeptomcruise When singing with your dog, always have sunglasses 🕶 🐶

♬ Hold Me Closer - Elton John & Britney Spears

Za holivudskim zavodnikom ne zaostaje ni tehnološki mogul Ilon Mask, a upravo su njegovi snimci "zapalili" društvene mreže na teritoriji Balkana. Snimak u kome biznismen izjavljuje da rakija menja život, a da je nakon tri dana u Modriči on praktično postao alkoholičar nije jedini. U drugom snimku, takođe generisanom uz pomoć AI tehnologije, Mask "priznaje" da je iz Republike Srpske, a u trećem da jako voli Srbe i da se nada da će(mo) vratiti Kosovo. Naravno, ništa od ovog se nije desilo, već je samo rezultat korisničkog zahteva upućenog softveru sa veštačkom inteligencijom.

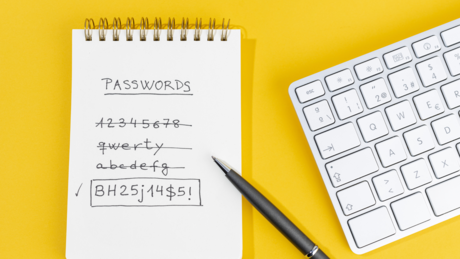

Kako ne upasti u zamku dipfejk tehnologija

Na sreću, dipfejk tehnologija još uvek nije dostigla svoj pik, a samim tim, postoje načini da prepoznamo da je u pitanju manipulacija. Osnovni preduslov za to je biti nepristrasan i ostaviti prostora za sumnju. Pa, ne verujemo ni svemu što vidimo i čujemo u realnom životu - zašto bismo onda slepo verovali onome što vidimo na internetu? Druga "crvena zastavica" na koju treba obratiti pažnju jesu usta osobe koja se nalazi na snimku - ovaj deo je često zamagljen više od ostatka lica kako se ne bi primetilo da pokreti ne odgovaraju izrečenom. I za kraj, da li primećujete da je snimak "robotizovan"? Da osoba ne trepće, govori ujednačenim tonom bez ijednog zamuckivanja ili pauze? Ukoliko da - najverovatnije je u pitanju dipfejk.