Pentagon želi da AI sistemi ubijaju bez ograničenja: Šta je "klod" i kakvu štetu može da napravi

Sjedinjene Američke Države i jedna privatna kompanija nalaze se usred "rata" oko nelegalnog korišćenja sistema veštačke inteligencije u vojne svrhe, što bi moglo da stvori presedan kojim će državni vrh dobiti opravdanje za akcije za koje neće snositi nikakvu odgovornost.

Korišćenje "kloda", AI sistema koji je kreirala kompanija "Antropik", već sada predstavlja presedan, ali skandal koji je usledio otkriva mnogo dublji problem.

Prema medijskim izveštajima, ovaj sistem je korišćen u planiranju američke vojne operacije usmerene na hvatanje venecuelanskog predsednika Nikolasa Madura.

Ispostavilo se da "Antropik" zastupa strogu etičku poziciju – njegovi AI sistemi ne smeju da se koriste za ratovanje ili masovni nadzor.

Ta ograničenja nisu marketinški slogani, ona su ugrađena direktno u arhitekturu softvera. Kompanija ih primenjuje interno i očekuje od klijenata da postupaju isto.

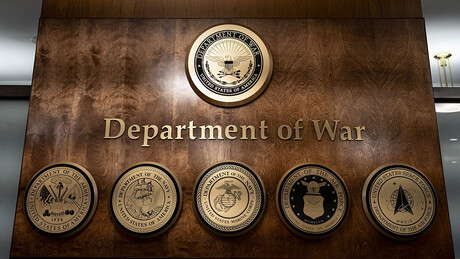

Pentagon, međutim, stvari vidi drugačije.

Prema dostupnim informacijama, američko Ministarstvo rata koristilo je "klod" bez obaveštavanja kompanije o nameni. Kada je to postalo javno i kada je "Antropik" uložio prigovor, odgovor vojske bio je nedvosmislen.

Zvaničnici su zatražili pristup "čistoj" verziji sistema – lišenoj moralnih i etičkih ograničenja – uz obrazloženje da im upravo ta ograničenja onemogućavaju da obavljaju svoj posao.

"U srcu ovog sukoba nalazi se filozofski raskol između dva nepomirljiva tabora. Jedan veruje da nove tehnologije moraju biti maksimalno iskorišćene, bez obzira na dugoročne posledice. Drugi strahuje da, kada se jedna granica pređe, kontrolu može biti nemoguće povratiti", napisao je u autorskom tekstu Vitalij Rjumšin, novinar i politički analitičar.

Nastajanje sukoba: Etika nasuprot vojne efikasnosti

Sukob između "Antropika" i Pentagona eskalirao je nakon što je ministar odbrane Pit Hegset izdao memorandum 9. januara, u kojem se pozivaju sve kompanije veštačke inteligencije da uklone svoja ograničenja i omoguće slobodnu vojnu primenu svojih tehnologija.

Odgovor kompanije bio je jasan i principijelan: "Vodimo produktivne razgovore, u dobroj veri", izjavili su iz "Antropika", ali su odbili da uklone osnovna etička ograničenja.

Pentagon je, sa druge strane, imao jasnu poruku – veštačka inteligencija "koja ne može da se bori", ne može biti deo njihovih operacija.

Hegset je čak zapretio da će kompaniju označiti kao "rizik za lanac snabdevanja", što bi značilo uklanjanje iz registra vojnih snabdevača. Ta oznaka bi praktično značila stavljanje na crnu listu – svaka firma koja sarađuje sa Pentagonom morala bi da prekine odnose sa "Antropikom".

"Aksios" je preneo da je Hegset pozvao generalnog direktora kompanije Darija Amodeija na sastanak u utorak i da će on verovatno biti napet.

Izvori su sastanak najavili rečima "ili radiš ili odlaziš sa pozicije", naglašavajući pritisak i ozbiljnost situacije.

"Klod" je jedini AI model dostupan u poverljivim vojnim sistemima i ujedno najsposobniji model za osetljive poslove u oblasti odbrane i obaveštajnih službi. Pentagon ne želi da izgubi pristup "klodu", ali je ogorčen zbog odbijanja "Antropika" da u potpunosti ukloni svoje zaštitne mehanizme.

Zvaničnici ministarstva tvrde da pregovori nisu doneli nikakav napredak i da su na ivici propasti.

Američki mediji dodali su da je "Antropik" navodno spreman da ublaži ograničenja upotrebe, ali želi da izuzme dve oblasti – masovni nadzor nad američkim građanima i razvoj oružja koje dejstvuje bez ljudske intervencije.

Kompanija je, kako je naveo portparol, "posvećena korišćenju napredne AI u podršci nacionalnoj bezbednosti SAD".

Pentagon smatra da je preterano restriktivno da za svaku pojedinačnu primenu mora da traži odobrenje kompanije i zahteva da sve AI laboratorije svoje modele stave na raspolaganje za "sve zakonite namene".

"Klod" u vojnoj primeni i njegov značaj

Pored vojne operacije u Venecueli, model se koristi i za analizu poverljivih podataka uporedo sa tehnologijama kompanije "Palantir", što znači da bi uklanjanje "kloda" iz sistema izazvalo ozbiljne operativne poremećaje.

Pentagon je svestan da bi zamena drugim modelom, poput "IksAI" ili Guglovog "džeminija", bila tehnički i organizaciono zahtevna, jer ti modeli nisu dostigli isti nivo preciznosti i pouzdanosti.

"Dok Rusija pažljivo prati pregovore oko Ukrajine i tekuću sagu u vezi sa Telegramom, na drugoj strani Atlantika odvija se drama koja više podseća na naučnofantastični triler nego na klasičnu geopolitiku. Ovoga puta, međutim, nije reč o fikciji", najavio je Rjumšin.

"Antropik" je bio prvi koji je dobio dozvolu da radi na klasifikovanim mrežama vojske, ali je insistirao da se veštačka inteligencija koristi samo u okviru strogih etičkih ograničenja.

"Zamislimo sada sisteme oslobođene digitalnih ograničenja. Integrisane u autonomno oružje, obaveštajnu analizu ili platforme za nadzor. I bez fantazija o pobuni mašina, posledice su zabrinjavajuće. Odgovornost se briše. Privatnost postaje iluzija. Ratni zločini mogu se svesti na 'proceduralne greške'. Autonomnu mašinu ne možete izvesti pred sud", podseća ruski stručnjak.

Dodatni izazovi su konkurencija i međunarodni kontekst.

"Antropik" je preduzeo korake da njegova tehnologija ne dospe u ruke kineskih firmi, poručuju iz izvora bliskih firmi, što je dodatno podiglo tenzije i pokazalo globalni uticaj ovih tehnologija.

"OpenAI" je navodno takođe detektovao pokušaje kineskih kampanja da koriste njihove AI modele u nadzoru, ali je "klod" specifičan po integraciji u poverljive vojne sisteme i po visokom stepenu kontrole koju "Antropik" insistira da zadrži.

Sukobi nisu samo filozofski

Sukob koji preti da eskalira odražava širi problem kontrole nad veštačkom inteligencijom.

Pentagon traži maksimalnu fleksibilnost, bez obzira na etičke posledice, dok kompanije poput "Antropika" insistiraju na "sloju bezbednosnih ograničenja" ugrađenom u model.

"Prvo ozbiljno suočavanje vojne ambicije i etike veštačke inteligencije", opisuje Rjumšin, naglašavajući da je "klod" postao simbol granica tehnologije i moralne odgovornosti.

Međutim, kako ističe, greška bi bila da se ovaj problem odbaci samo kao "američka stvar", već je u pitanju nešto što se tiče svih nas.

"I Rusija aktivno integriše AI u svoje vojne sisteme. Veštačka inteligencija već pomaže udarnim dronovima u prepoznavanju ciljeva, zaobilaženju elektronskog ometanja i koordinaciji 'rojeva'. Za sada su ti sistemi pomoćni alati, pod čvrstom ljudskom kontrolom. Ali njihovo uvođenje znači da će i Moskva uskoro biti suočena sa istim dilemama koje se danas razmatraju u Vašingtonu", poručuje analitičar.

Da li je to nužno loše? Ne.

"Veštačka inteligencija će transformisati vojne poslove, kao što će promeniti i civilni život. Pretvarati se da je suprotno bilo bi naivno. Zadatak nije odbaciti budućnost, već joj pristupiti otvorenih očiju", dodaje Rjumšin.

"Klod" predstavlja prekretnicu u istoriji vojne veštačke inteligencije. Njegova upotreba, sukob oko etičkih ograničenja i pritisak Pentagona pokazuju koliko je teško naći ravnotežu između tehnološke moći i moralne odgovornosti.

"Svakako, era 'ubilačke veštačke inteligencije' više nije hipotetička. Ona dolazi kroz ugovore o nabavci i korporativne ultimatume", zaključuje Vitalij Rjumšin.